robots.txtファイル

robots.txtファイルとは、検索エンジンのロボット(クローラー)に、どのページやファイルをそのウェブサイトから取得できるのか、取得することが出来ないのかを指示をして知らせるためのテキストファイルです。

また、このrobots.txtファイルは検索エンジンに負荷が加わる状態を避けるためにも利用されます。

SEOに与える影響

SEOの効果としては、閲覧するユーザーにとって価値のないページや、広告ページ、会員専用ページなどをrobots.txtファイルを利用し、制御することでウェブサイト全体の品質が向上する可能性はあります。

ただ、逆を言えばrobots.txtファイルが正しく構成されない場合、特に大規模なウェブサイトなどは問題を引き起こす可能性があるので注意しましょう。

robots.txtファイルの変更・設定には十分注意する

robots.txtファイルの設定によっては、検索エンジンがウェブサイトの大部分にアクセスできない可能性も秘めているため、十分に注意しましょう。

robots.txtファイルの利用用途

※robots.txtファイルは、重複するコンテンツを減らすために頻繁に使用され、それによって内部リンクやインデックスが強制終了されるため、十分に注意してください。

例えば、一般的な使用例としては以下の方法が挙げられます。

- ウェブサイト内のセクションやグループを非公開にする

- 「XMLサイトマップ」の場所を指定できる

- 「重複するコンテンツ」が検索結果等に表示されないようにする

(「canonicalタグ」や「301リダイレクト」の方が適している場合があるため注意) - 内部の検索結果が検索エンジンに表示されないようにする

(「noindex属性」も利用検討) - 検索エンジンが特定のファイル(PDFファイルなど)をインデックス登録できないようにする

- クローラーが複数のコンテンツを一度にロードするときにサーバーが過負荷になるのを防ぐために、クロール遅延を指定する

もちろん、設定したからと言って大きな順位変動が見られるものではありませんが、常に最新の状態を保つことにより、ウェブサイトのクロールを手助けする役割があり、ウェブサイトを運営する場合は必ず設定しておきましょう。

robots.txtファイルとnoindexの関係性

robots.txtファイルでクロールを禁止したページ(Disallow:)に、noindex属性を付けた場合は、Googleはrobots.txtを優先し、そのページにアクセスできないため、noindex属性を確認することが出来なくなります。

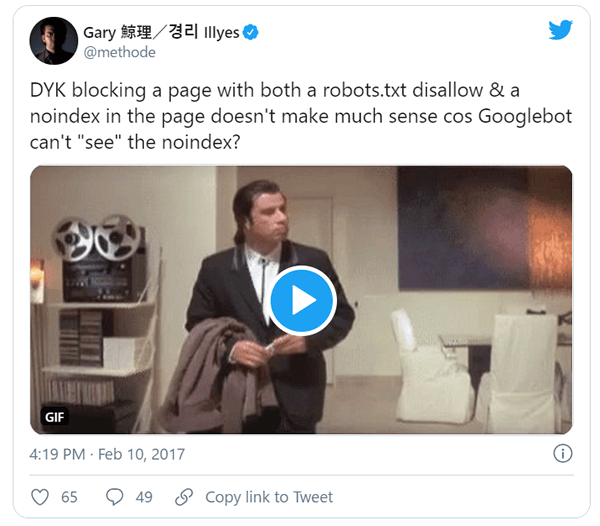

以下はGoogleのゲイリー氏がTwitterでツイートしたrobots.txtファイルの内容です。

robots.txtの禁止とページ内のnoindexの両方でページをブロックするDYKは、Googlebotがnoindexを「見る」ことができないのであまり意味がありませんか?robots.txtを「無視」することはなく、特定のページはクロールされません。そのような場合でも、noindexは表示されません。

robots.txtファイルの書き方

ファイル内で使用され書き方としては、

- User-agent:ルールの適用対象となる検索エンジン ロボット(ウェブクローラーソフトウェア)の名前を指定。アスタリスク(*)は、各種の AdsBot クローラーを除くすべてのクローラーに一致

- Disallow:クローラーのアクセスを制御するファイル(ページ等)を指定する

- Allow:指定されたユーザー エージェントによるクロールを許可するディレクトリまたはページ(ルートドメインの相対 URL)

- Sitemap:対象ウェブサイトのサイトマップがある場所(サイトマップXML)

以上の4つとなり「User-agent」は必須、「Disallow」「Allow」に関しては、ファイル内に少なくとも1つ以上必要です。

また、「User-agent」はアスタリスク(*)を利用する場合が一般的ですが、Google クローラーの概要(ユーザー エージェント)に一覧が掲載されています。

以下のような形でrobots.txtファイルを構成します。

# Googlebotをブロックする場合 User-agent: Googlebot Disallow: / # GooglebotとAdsbotをブロックする場合 User-agent: Googlebot User-agent: AdsBot-Google Disallow: / # すべてのクローラーをブロックする場合 User-agent: * Disallow: / # 通常のウェブサイトの場合 User-agent: * Disallow:/example/ Sitemap:http://example.com/sitemap.xml # WordPressの場合 User-agent: * Disallow: /wp-admin/ Allow: /wp-admin/admin-ajax.php Sitemap:http://example.com/sitemap.xml

例えば、robots.txtファイルの中で、Googleのクローラーに取得出来ないことを知らせる(Disallow)と、そのページは基本的(※1)にGoogle検索に「インデックス」されないため注意してください。

- ※1:Googleはrobots.txtファイルで指定したDisallowを意図的に無視してインデックス登録する場合があります。

(例:重要なページを指定しているとGoogle検索が考える場合。)

良くある質問

robots.txtファイルで良くある質問を記載しております。

robots.txtファイルは、ルートフォルダの直下に設定します。例としては、「https://example.com/robots.txt」の場所にあります。

利用するサーバーによっては、すでにルートフォルダに「robots.txtファイル」が設置されている場合が多いです。

※の場合は、

WordPressの場合、インストールした際に、「仮想robots.txt」を出力しています。

そのため、ファイルの中を探しても見当たらないはずです。どのような設定がされているかは「https://example.com/robots.txt」を確認しましょう。

再設定する場合は、「public_html」にrobots.txtファイルをアップロードする方法や、functions.phpに追加する方法、プラグインを利用する方法など、様々です。

著作者:辻 昌彦

コメント・フィードバック

フィードバックいただいた、SEOへのご意見や見解は内容を管理者が確認し、当文章に掲載される可能性がございます。